AI助手选择全攻略:从原理到实战,2026年4月9日

一、开篇引入:AI助手已成开发者必修课

本文聚焦 AI助手选择 这一核心话题,深度拆解RAG、微调、MCP三大关键概念,带你从“会用”到“懂原理”,再到“会选型”,打通完整知识链路。

AI编程助手正以惊人的速度渗透到每一位开发者的日常工作中。Sonar 2026年开发者调查报告显示,72%的开发者已实现每日使用AI编码工具,AI生成或辅助代码占比已达42%,较2023年的6%大幅跃升-16。一个尴尬的现实是:绝大多数开发者处于“会用但不懂”的状态——会用AI补全代码,却说不清RAG(Retrieval-Augmented Generation,检索增强生成)和微调的本质区别;知道Claude Code和Cursor,却答不出“AI助手是如何调用外部工具的”。

与此同时,AI助手领域的竞争格局正发生剧烈变化。2026年2月全球AI工具趋势报告显示,在71%的工具流量下滑的大背景下,Claude环比增速达到+43.07%,成为2月最大赢家;而ChatGPT市占率首次跌破45%,从52.85%降至44.23%-4。更值得注意的是,Claude Code已成为最受开发者喜爱的AI编码工具,以46%的喜爱度远超Cursor(19%)和GitHub Copilot(9%)-15。

选择正确的AI助手,不再是简单的工具偏好问题,而是关乎开发效率、技术架构甚至职业竞争力的关键决策。本文将从概念辨析→技术原理→代码示例→选型指南→面试要点五个维度,帮你建立关于AI助手的完整知识链路。

二、痛点切入:为什么AI助手突然变得不可或缺?

先看一个典型的“传统开发”场景——实现一个简单的“获取天气信息”功能。

传统方式:硬编码API调用 def get_weather(city): 硬编码天气API接口 url = f"https://api.weather.com/v1/{city}" response = requests.get(url, headers={"api-key": "FIXED_KEY"}) return response.json() def main(): city = input("请输入城市名:") weather = get_weather(city) 只有这一种能力 print(f"{city}天气:{weather}")

这段代码看起来简单直接,但暴露了传统方式的三大痛点:

耦合高:API接口、认证方式全部硬编码,换一家天气服务商就要改代码。

扩展性差:想要“根据天气推荐穿搭”或“对比两个城市天气”,需要手动添加大量逻辑。

维护困难:每个需求都是“硬编码”,代码量线性增长,维护成本指数上升。

而AI助手的出现,本质上是为了解决“如何让程序具备理解和执行复杂指令的能力”这一根本问题。它不再是简单的“if-else逻辑树”,而是一个能够理解意图、拆解任务、调用工具、自主决策的智能执行体。

从市场数据来看,这一需求正在被急剧放大:Belitsoft发布的2026年AI Agent发展预测显示,AI Agent市场在2025年价值80.3亿美元,到2026年预计达到117.8亿美元,年复合增长率高达46.61%;Gartner预测到2026年,40%的企业应用将集成具备特定任务的AI Agent-1。

二、核心概念讲解:RAG(检索增强生成)

定义

RAG = Retrieval-Augmented Generation(检索增强生成)

这是一种让大模型在回答问题时,先从外部知识库中检索相关信息,再结合检索内容生成答案的技术架构。

关键词拆解

检索:从向量数据库中与用户问题最相关的知识片段

增强:将检索到的知识作为“参考资料”注入到模型的输入中

生成:大模型基于“问题 + 检索结果”来生成最终答案

生活化类比:开卷考试 vs 闭卷考试

想象一下,你要回答一个关于“字节跳动2026年战略方向”的问题:

传统大模型(闭卷考试) :只凭训练时记住的知识(截止到2025年某月),问你2026年的战略,它只能靠“猜”或者“编”。

RAG(开卷考试) :允许你现场翻阅最新的资料库,找到梁汝波2026年1月29日的全员大会讲话,再结合原文回答问题-47。

这就是RAG的核心价值——让AI不依赖“死记硬背”,而是“现查现答”。

作用与价值

解决幻觉问题:大模型“一本正经地胡说八道”是业界顽疾。IDC预测,到2026年,超过60%的企业级AI应用将采用RAG架构以确保信息的真实性-21。

知识实时更新:企业政策、产品文档更新后,只需重新上传文档即可生效,无需重新训练模型-21。

增强可解释性:AI可以告诉用户“我的回答参考了XX文档的第X段”,方便溯源验证。

三、关联概念讲解:微调(Fine-Tuning)

定义

微调 = Fine-Tuning(全参数微调 / 参数高效微调)

这是一种在预训练大模型的基础上,用特定领域的数据集继续训练,使模型“内化”该领域的知识、风格和推理模式的技术。

关键词拆解

预训练:大模型已经在海量通用数据(如互联网文本)上完成了“基础教育”

微调:用少量高质量的专业数据(如法律文书、医学论文)进行“专业进修”

内化:知识不再是外部检索,而是融入模型的权重参数中,成为模型“本能”

对比RAG与微调的关系

| 对比维度 | RAG | 微调 |

|---|---|---|

| 本质定位 | 检索外部知识,动态参考 | 内化领域知识,改变模型行为 |

| 知识更新速度 | 秒级(上传文档即生效) | 数小时到数天(需重新训练) |

| 计算成本 | 低(仅向量检索+生成) | 高(GPU训练) |

| 可解释性 | 强(可溯源到引用文档) | 弱(知识融入模型,难以追踪来源) |

| 典型场景 | 客服问答、企业知识库 | 特定风格写作、领域专家模型 |

简单示例说明

场景:让AI写公司内部的“周报” RAG方式: - 检索过去3个月的优秀周报样本 - 结合当前周的工作记录,参考格式生成 - 优点:格式随时可调,风格参考最新样本 微调方式: - 用1000份优秀周报数据微调模型 - 模型“学会了”周报的写作风格、语气、结构 - 优点:写出来的周报“浑然天成”,不依赖外部参考

一句话高度概括

RAG是“开卷考试”——现查现答,灵活但依赖检索质量;微调是“专业进修”——内化知识,稳定但成本高昂。

四、概念关系与区别总结:RAG vs 微调

两者并非“非此即彼”的对立关系,更多是互补关系。在企业级AI应用中,典型的组合策略是:

80%的长尾需求:通过通用大模型 + RAG解决

20%的核心场景:通过微调提升专业表现-20

为了帮助记忆,这里用一个学习类比来强化理解:

| RAG | 微调 | |

|---|---|---|

| 类比 | 查资料写论文 | 长期学习内化为能力 |

| 知识来源 | 外部检索 | 内部权重 |

| 更新成本 | 低 | 高 |

| 遗忘风险 | 无(不改变模型) | 有(灾难性遗忘) |

五、代码 / 流程示例:从零实现一个简易RAG

下面用Python实现一个极简的RAG示例,突出核心逻辑:

极简RAG实现(不依赖向量数据库,仅演示核心流程) 1. 构建知识库(模拟) knowledge_base = { "AI助手选择": "2026年,选择AI助手应关注RAG能力、工具调用(MCP)支持、成本控制三大维度。", "RAG原理": "RAG(检索增强生成)通过检索外部知识库来增强大模型回答的真实性。", "Claude Code": "Claude Code是终端优先的AI编程代理,2026年3月调查中以46%喜爱度排名第一。" } 2. 检索函数(模拟相似度匹配) def retrieve(query): """检索与查询最相关的知识""" 简化版:关键词匹配 for keyword, content in knowledge_base.items(): if keyword in query or query in keyword: return content return "未找到相关知识。" 3. 生成函数 def generate_with_rag(query, retrieved_context): """基于检索结果生成答案""" prompt = f""" 用户问题:{query} 参考知识(来自知识库): {retrieved_context} 请基于以上知识,用通俗语言回答用户问题。如参考知识不足,请说明。 """ 实际场景中这里调用大模型API(如Claude、GPT) 此处用模拟输出演示 return f"[基于检索]{retrieved_context}" 4. 完整RAG流程 def rag_qa(query): print(f"用户问题:{query}") context = retrieve(query) print(f"检索到的知识:{context}") answer = generate_with_rag(query, context) print(f"生成答案:{answer}") return answer 测试 rag_qa("RAG原理是什么?")

执行流程解读:

用户提问:“RAG原理是什么?”

检索阶段:在知识库中找到

"RAG原理": "RAG通过检索外部知识库..."增强阶段:将检索内容注入到生成prompt中

生成阶段:大模型基于检索内容生成答案

关键注释:

真实RAG系统中,检索基于向量相似度而非关键词匹配

需要Embedding模型将文本转为向量

需要向量数据库(如Chroma、Pinecone)存储和检索

六、底层原理 / 技术支撑:MCP(Model Context Protocol)

理解了RAG和微调的区别后,一个新的问题自然浮现:AI助手如何实际“做事”? 光会回答不行,还得能查数据库、发邮件、调API——这就引出了MCP协议。

MCP是什么?

MCP = Model Context Protocol(模型上下文协议),由Anthropic于2024年11月推出,并于2025年12月捐赠给Linux基金会旗下的Agentic AI Foundation-35。

一句话理解MCP

MCP就是AI助手调用外部工具的“USB-C接口” ——标准化了AI如何发现、调用和使用各种外部工具和数据源。

为何需要MCP?

在MCP出现之前,要让AI调用一个外部API,你需要:

传统方式:为每个工具写专门的调用代码 def use_weather_tool(): 每个工具都要单独适配 pass def use_database_tool(): 耦合度极高 pass

而MCP提供了一个统一协议,让AI助手可以:

动态发现工具:通过

tools/list端点实时了解有哪些可用工具-35标准化调用:所有工具通过统一的JSON-RPC 2.0协议调用

跨平台兼容:Claude、ChatGPT、Cursor、VS Code等超过500个客户端已支持MCP-35

MCP生态现状(截至2026年初)

| 指标 | 数据 |

|---|---|

| 活跃MCP服务器 | 超过10,000个-35 |

| MCP客户端 | 超过500个(涵盖主流平台)-35 |

| 月均SDK下载量 | 9700万次-35 |

MCP使AI能够从被动的问答助手进化为能主动调用工具、执行任务的Agent。如果说RAG解决了“AI知道什么”的问题,MCP则解决了“AI能做什么”的问题。

技术要点:MCP如何工作?

MCP基于JSON-RPC 2.0协议,核心流程如下:

用户指令 → 宿主(Host) → 客户端(Client) → MCP服务器(Server) → 外部工具 ↓ 返回结果整合 → 大模型生成最终回答

三个关键机制:

工具发现:

tools/list让Agent知道有哪些工具可用工具调用:

tools/call执行具体操作能力协商:

initialize握手阶段进行能力匹配

七、AI助手选型实战指南:2026年主流工具对比

有了上述理论基础,回到最实际的问题:2026年,应该如何选择AI编程助手?

市场格局速览(2026年3月数据)

| 排名 | 工具 | 喜爱度 | 定位 | 特点 |

|---|---|---|---|---|

| 1 | Claude Code | 46% | 终端Agent | 深挖代码库、自主执行、Rust重写 |

| 2 | Cursor | 19% | AI原生IDE | Agent工作台、Cloud Agents |

| 3 | GitHub Copilot | 9% | 代码补全 | 微软生态、企业默认选项 |

数据来源:The Pragmatic Engineer March 2026 AI tooling survey(906名受访者)-15

选型决策树

你是哪种开发者? ├── 终端重度用户(常用git、shell、排障、重构) │ └── → Claude Code[reference:15] ├── 主要工作场景在编辑器内 │ ├── 追求完整开发体验 → Cursor │ └── 已深度绑定微软生态 → GitHub Copilot ├── 需要云端沙箱、多Agent并行委派 │ └── → OpenAI Codex[reference:16] └── 追求极致效率 → Cursor + Claude Code 双持组合[reference:17]

成本意识与选型策略

AI助手的成本并非仅仅是订阅费。Sonar报告指出,虽然AI生成代码占比已达42%,但开发者平均仅感知35%的效率提升,验证成本成为新的效率瓶颈-16。原因在于:

96%的开发者不完全信任AI代码的正确性-16

95%需额外投入时间进行审查,其中59%认为审查成本较高-16

在选择AI助手时,除了关注功能和价格,还需评估:

代码质量:工具生成代码的准确率和可维护性

审查成本:diff查看体验、上下文理解能力

集成深度:是否能融入现有CI/CD和代码审查流程

八、高频面试题与参考答案

面试题1:RAG和微调的区别是什么?什么时候用哪个?

参考答案(踩分点:定义→对比→选型策略):

定义区分:RAG(检索增强生成)是在推理时从外部知识库检索信息来增强回答;微调是在预训练模型上用特定数据继续训练,让知识内化到模型权重中。

核心差异:RAG知识更新快、成本低、可解释性强;微调知识内化深、特定领域表现更优、但成本高且可能发生过拟合。

选型策略:80%的场景用RAG(客服、企业知识库),20%的核心场景用微调(特定风格、专有领域术语)。实际生产中最优方案往往是“RAG + 微调”的组合。

面试题2:什么是MCP?它解决了什么问题?

参考答案(踩分点:定义→问题→价值):

MCP(模型上下文协议)是由Anthropic提出的标准化协议,用于AI Agent发现和调用外部工具。它基于JSON-RPC 2.0,提供工具发现、调用和能力协商三大核心能力。

解决的问题:在MCP出现前,AI调用每个外部工具都需要编写特定适配代码,耦合度高、可扩展性差。MCP通过统一协议标准,让AI可以动态发现工具、标准化调用、跨平台复用。

价值:截至2026年初,已有超过10,000个MCP服务器和500多个客户端支持MCP,月均SDK下载量达9700万次,已成为AI Agent领域的实际标准。

面试题3:为什么Claude Code能在2026年成为最受喜爱的AI编码工具?

参考答案(踩分点:产品定位→市场数据→差异化优势):

Claude Code的核心优势在于其精准的产品定位:它没有试图做一个“全能工具”,而是专注成为“最强大的终端优先编程Agent”。

差异化能力:能完整阅读代码库、理解架构、跨多文件规划修改、自主执行git和shell命令,2026年2月用Rust重写后启动速度更快。2026年3月底上线的Computer Use功能进一步实现了“完全无人值守”的开发流程。

市场数据佐证:The Pragmatic Engineer 2026年3月调查显示,Claude Code以46%的喜爱度排名第一,远超Cursor(19%)和Copilot(9%),尤其在小型企业中渗透率高达75%。Anthropic的Opus和Sonnet模型在编码任务中的提及率超过所有其他模型的总和-15。

面试题4:大模型的“幻觉”问题如何解决?

参考答案(踩分点:问题本质→RAG方案→MCP补充):

幻觉的根源:大模型本质上是概率生成模型,在缺乏相关知识时会“编造”答案来维持回答的流畅性。

RAG是核心解决方案:通过在生成前检索外部知识库,将“闭卷考试”变为“开卷考试”,从根本上降低幻觉。IDC预测,到2026年超过60%的企业级AI应用将采用RAG架构。

MCP作为补充:对于需要执行实际操作(而非纯问答)的场景,MCP允许Agent通过工具调用获取实时、确定性的数据,进一步规避生成式幻觉。

九、结尾总结

核心知识点回顾

| 概念 | 一句话总结 |

|---|---|

| RAG | 开卷考试:检索外部知识增强回答,解决幻觉和知识滞后 |

| 微调 | 专业进修:内化领域知识到模型权重,深度定制行为风格 |

| MCP | 标准化接口:让AI Agent统一调用外部工具,实现“知行合一” |

| Claude Code | 终端Agent之王:46%喜爱度,专注深挖代码库和自主执行 |

| Cursor | AI原生IDE:Agent工作台,编辑器内的开发体验标杆 |

重点强调与易错点

易错点1:不要把RAG和微调当成“二选一”,实际最佳实践是组合使用——RAG覆盖长尾,微调攻坚核心。

易错点2:不要高估AI代码的可靠性。72%开发者每日使用AI编码,但96%不完全信任AI代码,验证能力才是新的核心竞争力-16。

易错点3:不要认为选一个工具就够了。56%的开发者报告AI完成70%以上的工程工作,但真正的效率提升依赖于多工具组合和完善的验证体系-15。

趋势展望

AI开发正在从 “生成驱动”向“验证驱动”转型——生产效率的真正提升不再取决于代码生成速度,而取决于验证体系的成熟度与自动化水平-16。对于开发者而言,未来的核心竞争力不再是“写得多快”,而是“审查得多准、集成得多稳”。

下一篇将深入探讨AI Agent的多智能体协作架构,带你了解如何让多个AI Agent协同完成复杂的系统级任务。敬请期待!

参考数据来源:Sonar 2026 Developer Survey、The Pragmatic Engineer March 2026 AI Tooling Survey、Belitsoft AI Agent Development Forecast 2026、IDC企业AI应用预测

相关文章

-

AI助手选择全攻略:从原理到实战,2026年4月9日详细阅读

一、开篇引入:AI助手已成开发者必修课本文聚焦 AI助手选择 这一核心话题,深度拆解RAG、微调、MCP三大关键概念,带你从“会用”到“懂原理”,再到...

2026-04-27 2

-

AI助手和智能助手哪个好用?2026年4月终极选购与上手指南详细阅读

发布时间:2026年4月10日目标读者:技术入门/进阶学习者、在校学生、面试备考者、相关技术栈开发工程师文章定位:技术科普 + 原理讲解 + 代码示例...

2026-04-26 6

-

AI助手与早期AI区别:从“陪聊”到“干活”详细阅读

北京时间2026年4月10日 | 阅读约15分钟 写在前面 如果你刚接触AI不久,可能会以为“AI助手”就是ChatGPT那样的聊天机器人。但...

2026-04-26 6

-

高输入阻抗检测全攻略:从元器件选型到电路故障排查(适配传感器采集、仪器仪表与音频设备场景)详细阅读

在电子电路设计中,输入阻抗是一个容易被忽视却至关重要的参数。无论是工业传感器信号采集、精密仪器仪表的前端调理,还是Hi-Fi音频设备的缓冲级设计,高输...

2026-04-26 6

-

镍氢电池检测实操指南(适配消费电子智能家居医疗设备维修场景,新手入门+专业精准)详细阅读

一、引言 镍氢电池(Ni-MH电池)凭借高能量密度、环保特性和无记忆效应优势,已广泛应用于消费电子(数码相机、电动玩具、无线鼠标、手摇充电电筒)、智...

2026-04-26 7

-

石英晶振检测实操指南(适配通信消费电子工业控制场景)详细阅读

石英晶振作为电子系统的“心脏发生器”和“频率锚点”,广泛应用于5G基站、汽车电子、智能穿戴、工业控制、医疗器械等关键领域-...

2026-04-26 3

-

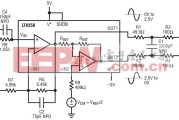

电源转换芯片正电压转负电压检测实操指南(汽车电子+工业控制适配,新手快速入门+专业精准)详细阅读

在新能源汽车的电机驱动器、工业控制柜的传感器供电板、精密医疗仪表的运放偏置电路,甚至你手边某块LCD显示屏的背光驱动模组中,正电压转换负电压的电源管理...

2026-04-25 8

-

电子维修中NPN三极管好坏检测实操指南(适配消费电子工业控制汽车电子三大场景)详细阅读

一、前言 在电子维修、工业设备维护以及汽车电子故障排查三大核心场景中,NPN三极管是最常见且最容易出问题的半导体器件之一。无论是家用电器开关控制、工...

2026-04-24 8

最新评论